2020년 9월 1일 NVIDIA는 Ampere 아키텍처를 기반으로 하는 RTX 3000 시리즈의 새로운 게임용 GPU 라인업을 공개했습니다. 우리는 새로운 기능, 함께 제공되는 AI 기반 소프트웨어, 그리고 이 세대를 정말 멋지게 만드는 모든 세부 사항에 대해 논의할 것입니다.

목차

RTX 3000 시리즈 GPU를 만나보세요

NVIDIA의 주요 발표는 모두 맞춤형 8nm 제조 프로세스를 기반으로 하고 래스터화 및 레이 트레이싱 성능 모두에서 주요 속도 향상을 가져오는 반짝이는 새로운 GPU였습니다.

라인업 최하단에는 RTX 3070, $499에 제공됩니다. NVIDIA가 초기 발표에서 공개한 가장 저렴한 카드의 경우 약간 비싸지만 정기적으로 $1400 이상에 판매되는 최고급 라인 카드인 기존 RTX 2080 Ti를 능가한다는 사실을 알게 되면 절대적인 도용입니다. 그러나 NVIDIA가 발표한 후 타사 판매 가격이 하락했고 많은 타사 제품이 eBay에서 $600 미만으로 패닉 판매되었습니다.

발표 시점에서 확고한 벤치마크가 없었으므로 카드가 2080 Ti보다 객관적으로 “더 나은”지 또는 NVIDIA가 마케팅을 약간 왜곡하고 있는지 여부는 불분명합니다. 실행 중인 벤치마크는 4K이고 RTX가 켜져 있을 가능성이 높기 때문에 Ampere 기반 3000 시리즈가 Turing보다 레이 트레이싱에서 두 배 이상 성능을 발휘할 것이기 때문에 순수한 래스터화된 게임보다 격차가 더 커 보일 수 있습니다. 그러나 이제 레이 트레이싱이 성능을 크게 해치지 않는 것이 되고 최신 콘솔 세대에서 지원되기 때문에 거의 3분의 1 가격으로 지난 세대의 주력 제품만큼 빠르게 실행하는 것이 주요 판매 포인트입니다.

가격이 이대로 유지될지는 미지수다. 타사 디자인은 정기적으로 가격표에 최소 50달러를 추가하고 수요가 얼마나 높을지와 함께 2020년 10월에 600달러에 판매되는 것을 보는 것은 놀라운 일이 아닙니다.

바로 그 위에는 RTX 3080 RTX 2080보다 두 배 빠르고 3080보다 약 25-30% 더 빨라야 하는 699달러입니다.

그런 다음 상단 끝에서 새로운 기함은 RTX 3090, 코믹하게 거대합니다. NVIDIA는 이를 잘 알고 있으며 회사에서 “Big Ferocious GPU”를 의미하는 “BFGPU”라고 부릅니다.

NVIDIA는 직접적인 성능 메트릭을 보여주지 않았지만 회사는 60FPS에서 8K 게임을 실행하는 것을 보여주었습니다. 이는 매우 인상적입니다. 물론 NVIDIA는 그 목표를 달성하기 위해 DLSS를 사용하고 있는 것이 거의 확실하지만 8K 게임은 8K 게임입니다.

물론, 결국에는 3060과 더 예산 지향적인 카드의 다른 변형이 있을 것이지만 일반적으로 나중에 나옵니다.

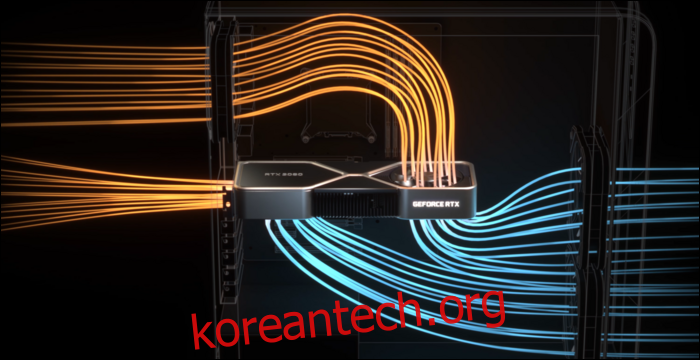

실제로 냉각을 위해 NVIDIA는 개선된 냉각기 디자인이 필요했습니다. 3080은 정격이 320와트로 상당히 높기 때문에 NVIDIA는 듀얼 팬 설계를 선택했지만 두 팬 vwinf를 하단에 배치하는 대신 NVIDIA는 일반적으로 백 플레이트가 가는 상단 끝에 팬을 배치했습니다. 팬은 공기를 CPU 쿨러와 케이스 상단으로 향하게 합니다.

케이스의 나쁜 공기 흐름이 성능에 얼마나 영향을 미칠 수 있는지 판단하면 이것은 완벽합니다. 그러나 이로 인해 회로 기판이 매우 비좁아 타사 판매 가격에 영향을 줄 수 있습니다.

DLSS: 소프트웨어의 장점

레이 트레이싱은 이 새로운 카드의 유일한 이점이 아닙니다. 사실, 그것은 모두 약간의 해킹입니다. RTX 2000 시리즈와 3000 시리즈는 이전 세대의 카드에 비해 실제 레이 트레이싱을 수행하는 데 그다지 좋지 않습니다. 블렌더와 같은 3D 소프트웨어에서 전체 장면을 레이 트레이싱하는 데는 일반적으로 프레임당 몇 초 또는 몇 분이 걸리므로 10밀리초 미만으로 무차별 대입하는 것은 불가능합니다.

물론 RT 코어라고 하는 레이 계산을 실행하기 위한 전용 하드웨어가 있지만 대부분 NVIDIA는 다른 접근 방식을 선택했습니다. NVIDIA는 노이즈 제거 알고리즘을 개선하여 GPU가 끔찍해 보이는 매우 저렴한 단일 패스를 렌더링하고 어떻게든 AI 마술을 통해 게이머가 보고 싶어하는 것으로 전환할 수 있습니다. 기존의 래스터화 기반 기술과 결합하면 레이트레이싱 효과로 향상된 쾌적한 경험을 제공합니다.

그러나 이를 빠르게 수행하기 위해 NVIDIA는 Tensor 코어라는 AI 전용 처리 코어를 추가했습니다. 이들은 기계 학습 모델을 실행하는 데 필요한 모든 수학을 처리하고 매우 빠르게 수행합니다. 그들은 총 클라우드 서버 공간의 AI 게임 체인저, AI는 많은 회사에서 광범위하게 사용됩니다.

잡음 제거 외에도 게이머를 위한 Tensor 코어의 주요 용도는 DLSS 또는 딥 러닝 슈퍼 샘플링이라고 합니다. 낮은 품질의 프레임을 가져와서 풀 네이티브 품질로 업스케일합니다. 이것은 본질적으로 4K 사진을 보면서 1080p 수준의 프레임 속도로 게임을 할 수 있음을 의미합니다.

이것은 또한 레이 트레이싱 성능에 상당한 도움이 됩니다.PCMag의 벤치마크 모든 레이 트레이싱 설정이 최대로 설정된 상태에서 RTX 2080 Super running Control을 초고품질로 보여줍니다. 4K에서는 19FPS로 어려움을 겪지만 DLSS를 켜면 훨씬 더 나은 54FPS를 얻을 수 있습니다. DLSS는 Turing 및 Ampere의 Tensor 코어로 가능해진 NVIDIA용 무료 성능입니다. 이를 지원하고 GPU가 제한된 모든 게임은 소프트웨어만으로도 상당한 속도 향상을 볼 수 있습니다.

DLSS는 새로운 것이 아니며 2년 전 RTX 2000 시리즈가 출시되었을 때 기능으로 발표되었습니다. 당시에는 NVIDIA가 각 개별 게임에 대해 기계 학습 모델을 훈련하고 조정해야 했기 때문에 매우 소수의 게임에서 지원되었습니다.

그러나 그 당시 NVIDIA는 새 버전을 DLSS 2.0이라고 하여 완전히 다시 작성했습니다. 모든 개발자가 구현할 수 있는 범용 API이며 대부분의 주요 릴리스에서 이미 채택하고 있습니다. 한 프레임에서 작업하는 대신 TAA와 유사하게 이전 프레임에서 모션 벡터 데이터를 가져옵니다. 결과는 DLSS 1.0보다 훨씬 더 선명하고 어떤 경우에는 실제로 기본 해상도보다 더 좋고 선명하게 보이므로 켜지 않을 이유가별로 없습니다.

컷신에서와 같이 장면을 완전히 전환할 때 DLSS 2.0은 모션 벡터 데이터를 기다리는 동안 50% 품질로 맨 처음 프레임을 렌더링해야 합니다. 이로 인해 몇 밀리초 동안 품질이 약간 떨어질 수 있습니다. 그러나 보는 모든 것의 99%는 제대로 렌더링되며 대부분의 사람들은 실제로 이를 알아차리지 못합니다.

암페어 아키텍처: AI용으로 제작

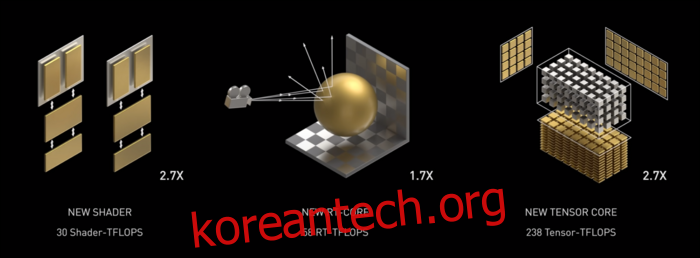

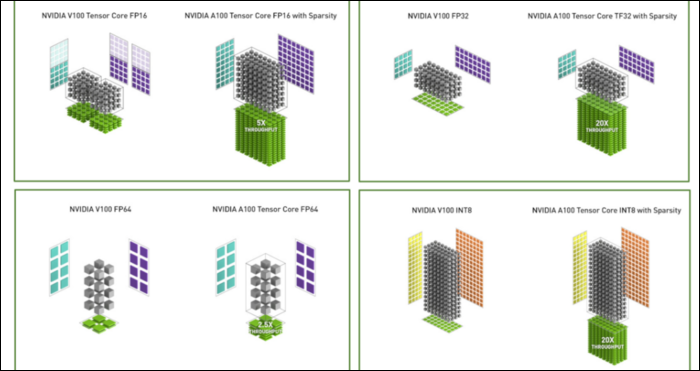

암페어는 빠릅니다. 특히 AI 계산에서 매우 빠릅니다. RT 코어는 Turing보다 1.7배 빠르며 새로운 Tensor 코어는 Turing보다 2.7배 빠릅니다. 이 둘의 조합은 레이트레이싱 성능의 진정한 세대 도약입니다.

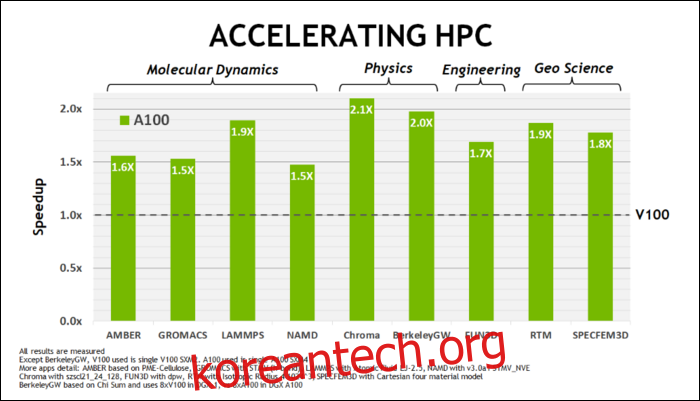

올 5월 초, NVIDIA, Ampere A100 GPU 출시, AI 실행을 위해 설계된 데이터 센터 GPU. 이를 통해 그들은 Ampere를 훨씬 더 빠르게 만드는 많은 것을 자세히 설명했습니다. 데이터 센터 및 고성능 컴퓨팅 워크로드의 경우 Ampere는 일반적으로 Turing보다 약 1.7배 빠릅니다. AI 교육의 경우 최대 6배 빠릅니다.

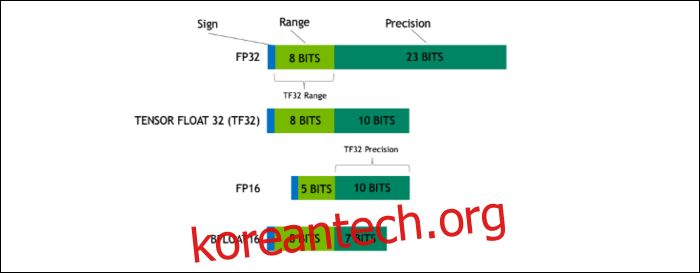

Ampere를 통해 NVIDIA는 일부 워크로드에서 업계 표준 “부동 소수점 32” 또는 FP32를 대체하도록 설계된 새로운 숫자 형식을 사용하고 있습니다. 내부적으로 컴퓨터가 처리하는 모든 숫자는 8비트, 16비트, 32, 64 또는 그 이상이든 상관없이 메모리에서 미리 정의된 비트 수를 차지합니다. 더 큰 숫자는 처리하기가 더 어렵기 때문에 더 작은 크기를 사용할 수 있다면 크런치할 수 있는 양이 줄어듭니다.

FP32는 32비트 십진수를 저장하며 숫자 범위(크기가 크거나 작을 수 있음)에 8비트를 사용하고 정밀도에 23비트를 사용합니다. NVIDIA의 주장에 따르면 이러한 23개의 정밀 비트는 많은 AI 워크로드에 완전히 필요한 것은 아니며 그 중 10개에서 유사한 결과와 훨씬 더 나은 성능을 얻을 수 있습니다. 크기를 32비트 대신 19비트로 줄이는 것은 많은 계산에서 큰 차이를 만듭니다.

이 새로운 형식은 Tensor Float 32라고 하며 A100의 Tensor 코어는 이상한 크기의 형식을 처리하도록 최적화되어 있습니다. 이것은 다이가 줄어들고 코어 수가 증가하는 것 외에도 AI 교육에서 6배의 엄청난 속도 향상을 얻는 방법입니다.

새로운 숫자 형식 외에도 Ampere는 FP32 및 FP64와 같은 특정 계산에서 주요 성능 속도 향상을 보고 있습니다. 이는 일반 사용자에게 더 많은 FPS로 직접 해석되지는 않지만 Tensor 작업에서 전반적으로 거의 3배 더 빠른 속도의 일부입니다.

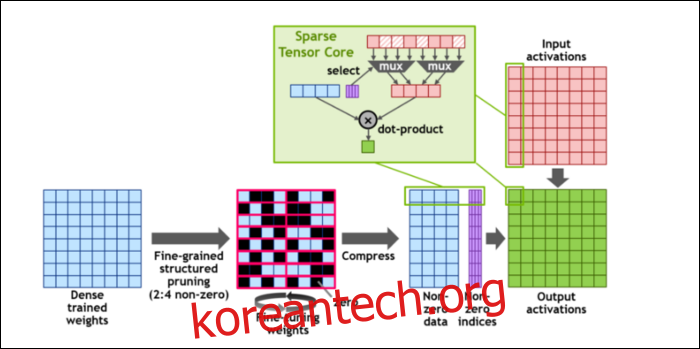

그런 다음 계산 속도를 더욱 높이기 위해 다음 개념을 도입했습니다. 세분화된 구조적 희소성, 이것은 아주 단순한 개념에 대한 매우 멋진 단어입니다. 신경망은 최종 출력에 영향을 미치는 가중치라고 하는 많은 숫자 목록과 함께 작동합니다. 크런치할 숫자가 많을수록 속도가 느려집니다.

그러나 이러한 숫자가 모두 실제로 유용한 것은 아닙니다. 그들 중 일부는 말 그대로 0이고 기본적으로 버려질 수 있으므로 동시에 더 많은 숫자를 처리할 수 있을 때 엄청난 속도 향상으로 이어집니다. 희소성은 기본적으로 숫자를 압축하므로 계산에 더 적은 노력이 필요합니다. 새로운 “Sparse Tensor Core”는 압축 데이터에서 작동하도록 구축되었습니다.

이러한 변경에도 불구하고 NVIDIA는 이것이 훈련된 모델의 정확도에 눈에 띄게 영향을 미치지 않아야 한다고 말합니다.

가장 작은 숫자 형식 중 하나인 Sparse INT8 계산의 경우 단일 A100 GPU의 최대 성능은 1.25페타플롭(PetaFLOP) 이상이며 이는 엄청나게 높은 수치입니다. 물론 특정 종류의 숫자를 처리할 때만 해당되지만 그럼에도 불구하고 인상적입니다.